OpenWebUI : une interface pour vos modèles d'IA

L'essor de l'IA générative a démocratisé l'accès aux modèles de langage, mais une question revient régulièrement pour les équipes techniques : comment offrir une interface utilisateur de qualité à ses propres modèles sans investir des mois de développement ? Les interfaces comme ChatGPT ou Claude ont établi un standard d'expérience que les utilisateurs attendent désormais, avec leur historique de conversations, leurs fonctionnalités de partage et leur ergonomie soignée.

L'essor de l'IA générative a démocratisé l'accès aux modèles de langage, mais une question revient régulièrement pour les équipes techniques : comment offrir une interface utilisateur de qualité à ses propres modèles sans investir des mois de développement ? Les interfaces comme ChatGPT ou Claude ont établi un standard d'expérience que les utilisateurs attendent désormais, avec leur historique de conversations, leurs fonctionnalités de partage et leur ergonomie soignée.

C'est précisément ce problème que résout OpenWebUI, un projet open source qui permet de déployer en quelques minutes une interface web complète pour interagir avec vos LLM. Que vous utilisiez des modèles locaux via Ollama, des API compatibles OpenAI, ou vos propres serveurs d'inférence, OpenWebUI offre une couche d'interaction professionnelle qui rivalise avec les solutions propriétaires.

L'intérêt de ce projet dépasse le simple confort d'utilisation. Pour les organisations soucieuses de souveraineté des données, OpenWebUI permet d'exposer des modèles hébergés en interne sans que les requêtes ne transitent par des serveurs tiers. Pour les équipes de développement, c'est un moyen rapide de mettre à disposition des prototypes ou des assistants spécialisés auprès d'utilisateurs non techniques.

Dans cet article, nous allons explorer les fonctionnalités d'OpenWebUI, comprendre comment le déployer et le configurer, et découvrir pourquoi il s'impose comme une solution de référence pour quiconque souhaite construire sa propre infrastructure d'IA conversationnelle.

Qu'est-ce qu'OpenWebUI ?

OpenWebUI est une interface web auto-hébergée conçue pour interagir avec des modèles de langage. Le projet, initialement nommé Ollama WebUI, a évolué pour supporter une variété de backends bien au-delà d'Ollama, ce qui lui a valu son nom actuel plus générique.

L'architecture du projet repose sur une séparation claire entre l'interface utilisateur et les modèles sous-jacents. OpenWebUI ne contient pas de modèle d'IA : il se connecte à des serveurs d'inférence externes — qu'il s'agisse d'Ollama tournant localement, d'une API OpenAI, ou de tout service compatible avec le protocole OpenAI. Cette approche modulaire offre une flexibilité considérable dans le choix et la gestion des modèles.

Les cas d'usage typiques incluent :

- Déploiement d'assistants internes : offrir aux collaborateurs un ChatGPT-like connecté à des modèles maîtrisés par l'entreprise

- Prototypage rapide : tester différents modèles et configurations avec une interface utilisateur immédiatement exploitable

- Environnements air-gapped : faire fonctionner une solution d'IA conversationnelle complètement déconnectée d'Internet

- Formation et démonstration : permettre à des utilisateurs non techniques d'expérimenter avec des LLM sans friction

| Aspect | ChatGPT / Claude | OpenWebUI |

|---|---|---|

| Hébergement | Cloud provider | Auto-hébergé |

| Données | Transitent par des serveurs tiers | Restent sur votre infrastructure |

| Modèles disponibles | Limités au provider | Tous modèles compatibles |

| Personnalisation | Limitée | Complète |

| Coût | Abonnement ou usage API | Gratuit (hors infrastructure) |

| Fonctionnalités avancées | Variables selon le plan | Toutes incluses |

La communauté autour d'OpenWebUI est particulièrement active, avec des mises à jour fréquentes qui ajoutent régulièrement de nouvelles fonctionnalités. Le projet compte plus de 50 000 étoiles sur GitHub, témoignant de son adoption massive par les développeurs et les organisations cherchant à reprendre le contrôle de leur infrastructure IA.

Fonctionnalités principales

OpenWebUI ne se contente pas de répliquer les fonctionnalités basiques d'un chat : il propose un ensemble de capacités qui en font une plateforme complète pour l'interaction avec les LLM.

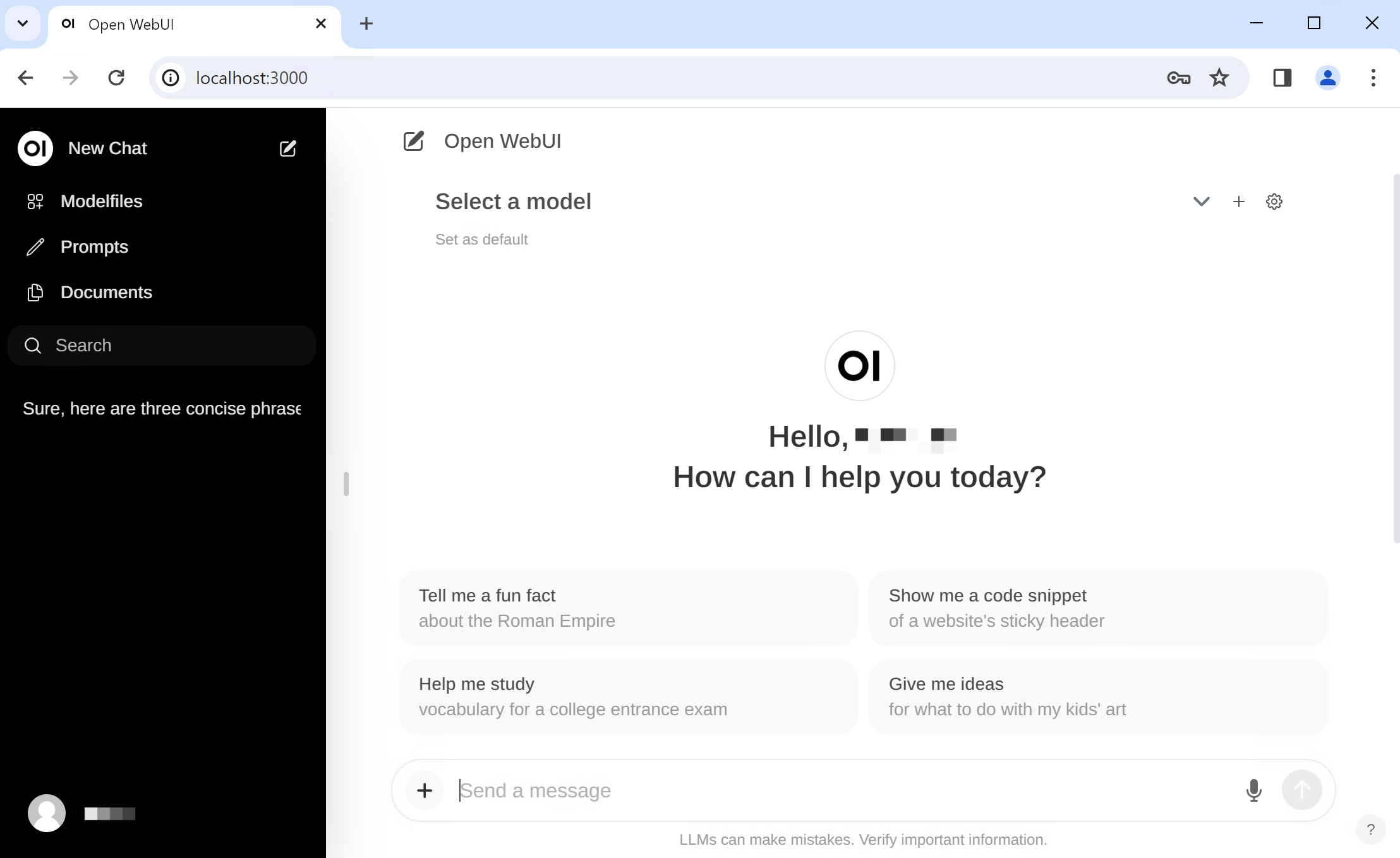

Interface conversationnelle et gestion des conversations

L'expérience utilisateur constitue le point fort immédiat d'OpenWebUI. L'interface reprend les codes établis par ChatGPT — barre latérale avec l'historique, zone de saisie en bas, réponses en streaming — tout en ajoutant des fonctionnalités supplémentaires :

- Organisation des conversations par dossiers et tags pour retrouver facilement les échanges passés

- Recherche dans l'historique pour naviguer dans des mois de conversations

- Export et import des conversations au format JSON pour la sauvegarde ou le partage

- Branching : possibilité de créer des embranchements dans une conversation pour explorer différentes directions

Le support du Markdown et du rendu de code avec coloration syntaxique rend l'interface particulièrement adaptée aux usages techniques. Les blocs de code peuvent être copiés en un clic, et les réponses longues bénéficient d'un formatage clair.

Support multimodal et RAG intégré

OpenWebUI va au-delà du texte pur en proposant des fonctionnalités multimodales natives :

- Upload d'images pour les modèles VLM comme LLaVA ou GPT-4 Vision

- Upload de documents (PDF, Word, texte) avec extraction automatique du contenu

- Système RAG intégré : les documents uploadés sont automatiquement indexés et peuvent être interrogés par le modèle

Cette fonctionnalité RAG built-in mérite qu'on s'y attarde. Sans écrire une ligne de code, un utilisateur peut uploader un PDF et poser des questions dessus. OpenWebUI gère le chunking, la vectorisation (via des modèles d'embedding configurables), le stockage dans une base vectorielle locale, et l'injection du contexte pertinent dans les requêtes. Pour des besoins simples, cela évite de construire un pipeline RAG complet avec LlamaIndex ou LangChain.

Personnalisation et system prompts

La personnalisation des comportements des modèles s'effectue à plusieurs niveaux :

- System prompts personnalisés : définir le comportement par défaut du modèle (rôle, ton, contraintes)

- Modelfiles : créer des configurations réutilisables combinant un modèle de base avec des paramètres spécifiques

- Presets : sauvegarder des combinaisons de paramètres (température, top_p, etc.) pour différents cas d'usage

Cette flexibilité permet de créer des assistants spécialisés sans toucher au code. Un même déploiement OpenWebUI peut exposer un assistant juridique utilisant un system prompt formel, un assistant créatif avec une température élevée, et un assistant technique avec des instructions précises — chacun accessible comme un "modèle" distinct dans l'interface.

À découvrir : notre formation LLM Engineering

Déploiement et configuration

L'installation d'OpenWebUI se veut accessible, avec Docker comme méthode privilégiée pour un déploiement rapide et reproductible.

Installation avec Docker

La méthode la plus simple pour démarrer utilise une seule commande Docker :

# Déploiement basique (connexion à Ollama sur localhost)

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

# Avec Ollama bundlé dans le même conteneur

docker run -d -p 3000:8080 \

--gpus all \

-v ollama:/root/.ollama \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:ollama

bash

Pour un déploiement plus robuste, un fichier docker-compose.yml permet de gérer OpenWebUI et Ollama comme services séparés :

version: '3.8'

services:

ollama:

image: ollama/ollama:latest

volumes:

- ollama:/root/.ollama

deploy:

resources:

reservations:

devices:

- capabilities: [gpu]

open-webui:

image: ghcr.io/open-webui/open-webui:main

ports:

- "3000:8080"

environment:

- OLLAMA_BASE_URL=http://ollama:11434

volumes:

- open-webui:/app/backend/data

depends_on:

- ollama

volumes:

ollama:

open-webui:

yaml

Connexion aux différents backends

La configuration des sources de modèles s'effectue via l'interface d'administration ou des variables d'environnement :

- Ollama :

OLLAMA_BASE_URLpointe vers le serveur Ollama (local ou distant) - API OpenAI :

OPENAI_API_KEYet optionnellementOPENAI_API_BASE_URLpour les endpoints compatibles - Autres backends : tout serveur exposant une API compatible OpenAI peut être connecté (vLLM, LMStudio, text-generation-inference)

Cette compatibilité avec le format OpenAI API est stratégique : elle permet de connecter OpenWebUI à pratiquement n'importe quel serveur d'inférence moderne sans configuration spécifique.

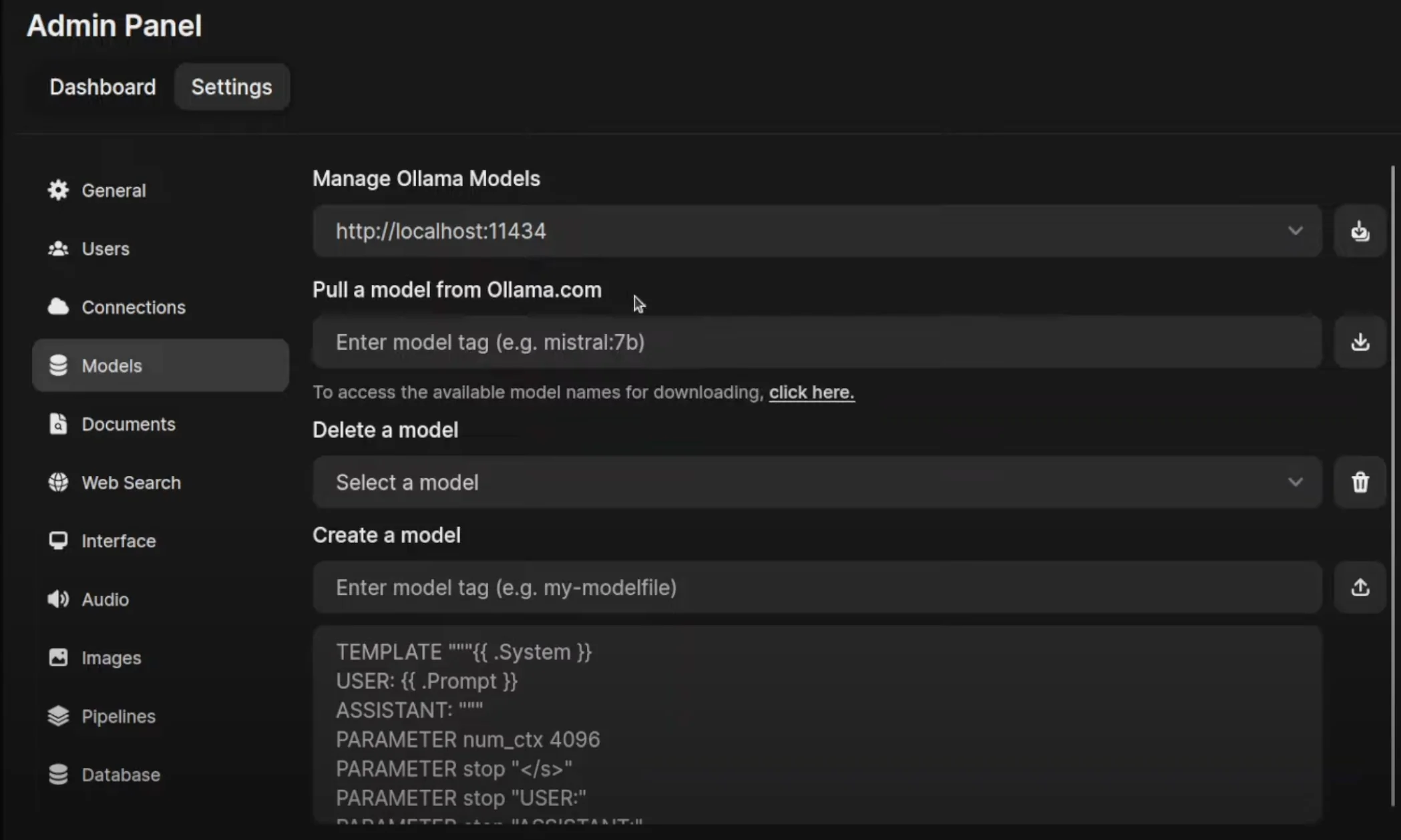

Gestion des utilisateurs et administration

OpenWebUI intègre un système d'authentification complet :

- Inscription et connexion avec email/mot de passe

- Rôles : administrateur, utilisateur standard, invité

- Quotas : limitation du nombre de requêtes par utilisateur

- SSO : intégration possible avec des providers OAuth (Google, GitHub, etc.)

Le panneau d'administration permet de gérer les utilisateurs, de configurer les modèles disponibles, d'ajuster les paramètres par défaut, et de monitorer l'usage. Cette dimension multi-utilisateurs fait d'OpenWebUI une solution viable pour des équipes, pas seulement pour un usage individuel.

Cas d'usage et intégration en entreprise

L'adoption d'OpenWebUI en contexte professionnel répond à des besoins spécifiques que les solutions SaaS ne couvrent pas toujours.

Souveraineté et conformité des données

Pour les organisations manipulant des données sensibles — secteur médical, juridique, financier, défense — la question de la localisation des données est critique. OpenWebUI couplé à des modèles locaux via Ollama garantit que aucune donnée ne quitte l'infrastructure :

- Les requêtes restent sur le réseau interne

- L'historique des conversations est stocké localement

- Les documents uploadés ne transitent par aucun service cloud

Cette architecture répond aux exigences de conformité (RGPD, HDS, réglementations sectorielles) tout en offrant une expérience utilisateur comparable aux solutions cloud.

Comparaison et évaluation de modèles

OpenWebUI permet de connecter simultanément plusieurs sources de modèles. Un utilisateur peut ainsi comparer dans la même interface :

- Un modèle Llama 3 local via Ollama

- GPT-4 via l'API OpenAI

- Un modèle Mistral hébergé sur un serveur interne

Cette capacité de benchmarking côte à côte est précieuse pour les équipes qui évaluent différentes options avant de standardiser sur un modèle. La fonction "Arena" permet même de faire évaluer deux réponses à l'aveugle par l'utilisateur, constituant un feedback précieux sur la qualité perçue des différents modèles.

Déploiement d'assistants métier

En combinant la gestion des system prompts, le RAG intégré et la personnalisation des modèles, OpenWebUI permet de créer rapidement des assistants spécialisés :

- Un assistant RH qui répond aux questions sur les politiques internes (alimenté par les documents de procédure)

- Un assistant technique qui connaît la documentation produit

- Un assistant juridique formé aux CGV et contrats types de l'entreprise

Ces assistants peuvent être exposés comme des "modèles" distincts dans l'interface, chacun avec son contexte et ses instructions propres, permettant aux utilisateurs de choisir l'assistant adapté à leur besoin.

Conclusion

OpenWebUI s'impose comme une solution de référence pour quiconque souhaite déployer une interface professionnelle devant ses propres modèles d'IA. En combinant une expérience utilisateur soignée, une flexibilité de configuration remarquable et une architecture respectueuse de la souveraineté des données, le projet répond à un besoin réel de l'écosystème IA.

Pour les développeurs et les équipes techniques, OpenWebUI représente un gain de temps considérable. Plutôt que de développer une interface from scratch — avec toutes les fonctionnalités attendues d'historique, de gestion des utilisateurs, de rendu Markdown, de streaming — on peut se concentrer sur ce qui compte vraiment : le choix et l'optimisation des modèles, la qualité des prompts, l'enrichissement du contexte.

L'évolution rapide du projet, portée par une communauté active, garantit que de nouvelles fonctionnalités continueront d'enrichir la plateforme. Le support récent des fonctionnalités RAG, de l'audio, et l'intégration de pipelines personnalisables témoignent de cette dynamique d'innovation continue.

Pour les organisations qui hésitent entre solutions cloud et infrastructure maîtrisée, OpenWebUI offre le meilleur des deux mondes : une expérience utilisateur au niveau des standards du marché, combinée à un contrôle total sur l'infrastructure, les données et les modèles utilisés. C'est cette combinaison qui explique son adoption massive et qui en fait un outil incontournable du toolkit de tout développeur IA soucieux de proposer des interfaces de qualité à ses utilisateurs.